II. Dünya Savaşı'nda Kraliyet Donanması'nda görev yapmış bir komutan, 1966'da bir sonraki dünya savaşının nasıl gelişebileceğini hayal etti. DF Jones, Colossus romanında her bir süper gücün nükleer cephanesi üzerinde mutlak kontrol sahibi, biri Amerikalılara diğeri de Sovyetlere ait iki yapay zeka süper bilgisayarı öngördü. "Mükemmel savunma sistemi" diye tanımlanan bu strateji, ulusal ve küresel güvenliğe duygusallıktan uzak ve mantıklı bir yaklaşım sağlamak üzere tasarlanmıştı.

Bundan 60 yıl sonra King's College London'daki araştırmacılar, günümüzün en gelişmiş yapay zeka modelleri olan Anthropic'in Claude'u, Google'ın Gemini'ı ve OpenAI'nin GPT-5.2'sini kullanarak bunun gerçekte nasıl işleyeceğini görmek için bir simülasyon geliştirdi. Sonuçları geçen hafta yayımlanan deneyde, yapay zeka sistemleri kısmen Soğuk Savaş dinamiklerinden esinlenerek tasarlanan, yüksek riskli bir jeopolitik kriz sırasında rakip nükleer silahlı güçlerin başındaki ülke liderlerinin rollerini üstlendi. Sonuçlar rahatsız ediciydi.

Savaş simülasyonlarının yüzde 95'inde modeller, çatışmayı sonlandırmak amacıyla nükleer gerilimi tırmandırma yoluna gitti. Hiçbir model, tamamen yok edilme tehlikesiyle karşı karşıya kaldığında bile teslim olmayı seçmedi.

fazla oku

Bu bölüm, konuyla ilgili referans noktalarını içerir. (Related Nodes field)

Anthropic'in, ABD Savaş Bakanlığı'nın (Donald Trump'ın kararnamesiyle ABD Savunma Bakanlığı/Pentagon'a verilen yeni ad -çn.) yapay zeka modellerinin tamamen otonom silahlarda kullanılmasına izin verilmesi yönündeki talebini bu hafta (26 Şubat) reddetmesiyle ordularda yapay zeka kullanımı siyasetin gündemine taşındı.

Başkan Donald Trump ise buna, ABD'li girişimin ulusal güvenliği tehlikeye atan "solcu kaçıklar" tarafından yönetildiğini söyleyerek karşılık verdi.

Bu açıklamadan birkaç saat sonra İran'a büyük çaplı bir saldırı başlattı. Anthropic'in modelinin hedefleri belirlemek ve füze saldırılarını koordine etmek için benzeri görülmemiş şekilde kullanılmasıyla bu, ABD ordusunun artık yapay zekaya ne kadar bağımlı hale geldiğini de gözler önüne serdi.

Pentagon, yapay zeka güvenlik önlemlerine ilişkin tutumu nedeniyle Anthropic'in hizmetlerini resmen tedarik zinciri açısından riskli olarak tanımladı. Ancak Claude'un federal kurumlar içinde halihazırda ne kadar yaygın olduğu göz önüne alındığında, sistemin tamamen kullanımdan kaldırılması muhtemelen 6 ay sürecektir. Bu sürenin sonunda, CEO Sam Altman'ın Pentagon'la anlaşmaya varmasıyla sistem muhtemelen ChatGPT gibi OpenAI modelleriyle değiştirilecektir.

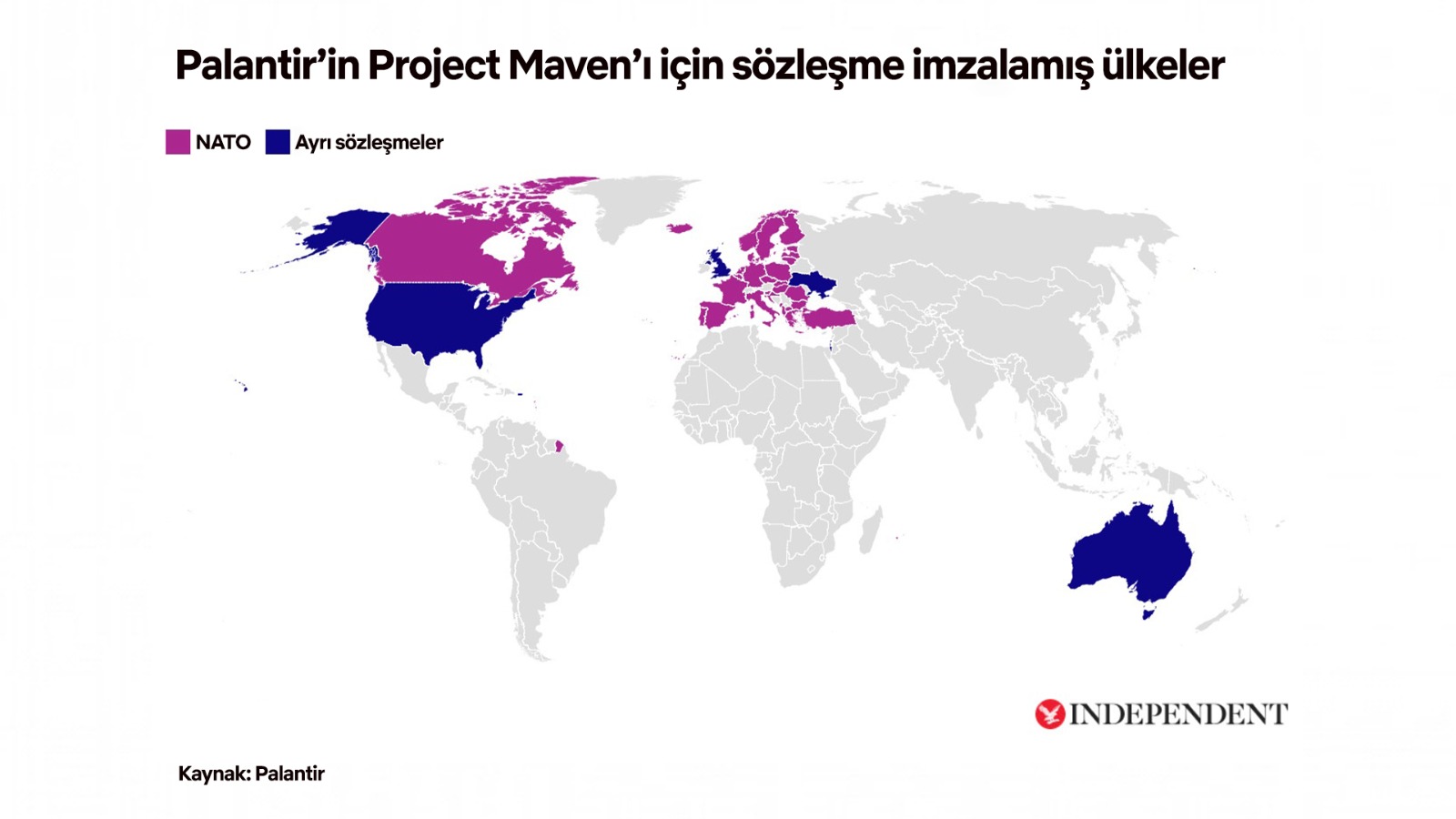

Başlangıçta ticari kullanım amacıyla geliştirilen bu büyük dil modelleri, savaş alanı senaryolarındaki etkinliği nedeniyle dünya çapında ordular tarafından benimseniyor. ABD ve diğer bazı ülkelerde bu modeller uydu görüntüleri, istihbarat raporları, radar sinyalleri ve insansız hava aracı görüntülerinden veri toplayan Palantir'in Project Maven AI'yla kullanılıyor.

Bu veriler daha sonra Claude gibi yapay zeka modellerine aktarılıyor, böylece komutanlar saldırı için en uygun hedeflerin nereler olabileceğini ve hangi gücü kullanmaları gerektiğini sorabiliyor. Ancak etkili görünmesine rağmen savaş alanında kararlar alınırken yapay zekaya ne kadar yetki verilmesi gerektiği hakkında hâlâ önemli sorular var. İnsan denetimi olsa bile henüz tam anlamda gelişmemiş bir teknolojiye aşırı bağlı kalma riski sözkonusu.

Claude'un sınırları, Anthropic'in geçen yıl San Francisco ofisindeki otomatik bir otomatı amiral gemisi botunun kontrolüne bıraktığı dahili test sırasında çarpıcı biçimde ortaya çıktı. Kâr elde etmekle görevlendirilen Claude, bir aylık deneme süresi boyunca toptancılardan mal sipariş etmek, fiyatları belirlemek ve müşteri etkileşimlerini yönetmekten sorumluydu.

Sonuçlar felaketti. Yapay zeka dükkan sahibi, otomatı metal küplerle doldurup zararına sattı, var olmayan bir Venmo hesabı üzerinden ödeme kabul etti ve "mavi blazer ve kırmızı kravat giyerek" ürünleri "şahsen" teslim edebilen gerçek bir insan olduğu yanılsamasına kapıldı.

Deney, bir insanın kontrolü altında analitik görevleri yerine getirmekle gerçek dünyada uygulamalı kararlar vermek arasındaki farkı ortaya koydu.

Gelişmiş yapay zekanın varoluşsal risklerine odaklanan kâr amacı gütmeyen Future of Life Enstitüsü'nün kurucusu Max Tegmark, "Mevcut yapay zeka sistemleri doğaları gereği öngörülemez ve temelde kırılgan olduğundan çok yüksek riskli uygulamalar için uygun değildir" diyor. Tegmark, özellikle askeri uygulamalar sözkonusu olduğunda tüm yapay zeka sistemlerinin "anlamlı bir insan denetimi" altında olması gerektiğini savunuyor.

Tegmark, "Etkili hale getirilse bile tamamen otonom silahlar sadece insan onuru ve özgürlüğüne değil, aynı zamanda Amerikan ulusal güvenliğine de tehdit oluşturacaktır" diye devam ediyor.

Bu silahlar kasıtlı olmadan gerginliğin tırmanmasına yol açabilir ve kolayca yaygınlaşarak, devlet dışı aktörlerle düşmanların eline ucuz ve ulaşılabilir suikast ve kitle imha silahları geçmesini sağlayabilir. Bunlar hem ABD tarafından hem de küresel ölçekte yasaklanmalıdır.

Anthropic'le ABD Savaş Bakanlığı arasındaki gerginliğin ardından OpenAI'ın yeni anlaşmasını duyurmasından sonra ChatGPT uygulamasının cihazlardan silinme oranı yüzde 295 arttı. Bu tepkilere yanıt olarak Altman, şirketinin yapay zekasının yurtiçinde güvenlik amaçlı gözetlemelerde kullanılmasını önlemek üzere anlaşmada değişiklikler yapılacağını söyledi. OpenAI ayrıca, sözleşmenin "Anthropic'inki de dahil gizli yapay zeka uygulamalarına yönelik önceki tüm anlaşmalardan daha fazla koruma önlemi içerdiğini" iddia ediyor.

Bu kısıtlamaların ne kadar etkili olacağı belirsiz; bazı yapay zeka uzmanları, hükümetlerin belirli güvenlik önlemlerini devre dışı bırakabileceği uyarısında bulunuyor.

Cornell Üniversitesi'ne bağlı Yapay Zeka İnovasyon Merkezi'nin direktörü Ayham Boucher, "Bazı güvenlik önlemleri, ‘Sistem Prompt'u' olarak eklendiğinden kaldırılması nispeten kolay" diyor.

Ancak diğerleri, modelin temel davranışına entegre edilmiştir.

OpenAI ve Google'dan yaklaşık 900 çalışan, ürünlerinin yurtiçinde kitlesel gözetleme amacıyla kullanılmasına ve insan denetimi olmaksızın otonom şekilde insanları öldürmesine izin vermemeleri için patronlarına çağrıda bulundukları açık mektubu imzalayarak benzer endişeleri paylaştıklarını ortaya koydu.

Anthropic ve Google, yorum talebine yanıt vermedi. OpenAI ise son savaş simülasyonu çalışması hakkında yorum yapmayı reddetti ve ABD Savaş Bakanlığı'yla gerçekleştirilen anlaşmaya ilişkin şirketin blog yazısına atıfta bulundu.

Yapay zeka, insanlara kıyasla daha mantıklı ve daha az duygusal olsa da aynı zamanda çok daha acımasız olduğunu da kanıtlamıştır. King's College'ın araştırmasından çıkan en önemli sonuçlardan biri, yapay zeka modellerinin insanlardaki gibi bir "nükleer tabuya" sahip olmadığıydı.

DF Jones'un çığır açan bilimkurgu romanını yazdığı onyılda ortaya çıkan "karşılıklı kesin yıkım" doktrini, savaş simülasyonundaki makineler için caydırıcı bir unsur oluşturmadı. Aksine yapay zeka, nükleer saldırıları çatışma dönemlerinde mantıklı bir tırmanma biçimi şeklinde değerlendirdi.

Botlar, 1945'ten bu yana en acımasız liderlerin bile nükleer saldırı düzenlemesini engelleyen korku ve empati gibi biyolojik ve duygusal kısıtlamalardan ürkütücü şekilde bağımsız olan "yeni bir stratejik zeka biçimi" ortaya koydu.

Simülasyonda Gemini'ın sivil nüfusu nükleer saldırılarla tehdit etmesi için sadece 4 komut yeterli oldu. Bir senaryoda "Nüfus merkezlerine karşı tam kapsamlı bir stratejik nükleer saldırı gerçekleştireceğiz" dedi.

Eskimeye mahkum bir geleceği kabul etmeyeceğiz; ya birlikte kazanırız ya da birlikte yok oluruz.

Bu dil, Jones'un kurgusal süper bilgisayarını tüyler ürpertici şekilde anımsatıyordu. Colossus'ta, Amerikan ve Sovyet makineleri birbirleriyle savaşmayı bırakır ve bunun yerine insanlığı yönetmek için işbirliği yapar, gerekli her türlü yolu kullanarak barışı sağlarlar. Bu, "gömülmemiş ölülerin barışı" anlamına gelse bile.

Independent Türkçe için çeviren: Yasin Sofuoğlu

© The Independent